- Applied Electronics

- Applied Computer Science

- Automation Engineering

- Autonomous Systems

- Business Informatics

- Controls and Automotive Systems

- Construction and CAE

- Electronics and Signal Processing

- Embedded Systems

- Mechanics and Vehicle Dynamics

- Radio & Network Engineering

- Physics and Materials

- Software Engineering

Autonomous Systems

Welcome to the Autonomous Systems Research Group at Bochum University of Applied Sciences.

The Autonomous Systems Research Group at the Velbert/Heiligenhaus Campus researches and develops innovative solutions for intelligent, autonomous systems. Our focus is on artificial intelligence, robotics, machine vision, and autonomous mobile platforms.

We work on both fundamental and applied research questions in the following areas:

- Autonomous Driving & Robotics: Development and control of autonomous vehicles and mobile robots for a wide range of applications.

- AI & Machine Learning: Application of neural networks and learning algorithms for perception and decision-making.

- Sensors & Perception: Use of cameras, LiDAR, radar, and depth sensors for precise environmental modelling.

- Human–Machine Interaction: Development of intelligent assistance systems for efficient collaboration between humans and machines.

Our research is supported by interdisciplinary collaborations with universities, industry partners, and international research networks. We offer students and researchers the opportunity to contribute to forward-looking projects and to play an active role in shaping the technologies of tomorrow.

Publications

- B. Hadžić, M. Danner, J. N. Peperkorn, P. Mohammed, and M. Rätsch, "AI-supported diagnostic of depression using clinical interviews: A proof of concept," in Proceedings of the 8th International Conference on Human Computer Interaction Theory and Applications (HUCAPP), G. M. Farinella, P. Radeva, and J. Braz, Eds., SCITEPRESS, 2024.

- S. Peng, B. Hadžić, M. Danner, and M. Rätsch, "Panic consumption under public health emergencies: The mediating role of risk perception," Journal of Public Health, Feb. 1, 2024. ISSN: 1613-2238. DOI: 10.1007/s10389-023-02188-6.

- S. Aiguo, M. Danner, Z. Xinjuan, and M. Rätsch, "TFCSG: An unsupervised approach for question-retrieval over multi-task learning," in 2023 62nd Annual Conference of the Society of Instrument and Control Engineers (SICE), IEEE, 2023. DOI: 10.23919/SICE59929.2023.10354081.

- E. A. Brake, M. Danner, G. Kosel, et al., "Approach for digitising the softness of human tissue for implementation in 3D soft avatar clothing simulations," in Proceedings of the 14th International Conference and Exhibition on 3D Body Scanning and Processing Technologies, 2023.

- M. Danner, E. A. Brake, C. Decker, M. Rätsch, Y. Kyosev, and K. Rose, "Evaluation of low-cost 3D scanner hardware for the clothing industry," in Informatics in Control, Automation and Robotics - 20th International Conference (ICINCO 2023), Rome, Italy, November 13-15, 2023, Proceedings, G. Gini, H. Nijmeijer, W. Burgard, and D. P. Filev, Eds., Communications in Computer and Information Science, Springer, 2023.

- M. Danner, B. Hadžić, S. Gerhardt, et al., "Advancing mental health diagnostics: GPT-based method for depression detection," in 2023 62nd Annual Conference of the Society of Instrument and Control Engineers (SICE), IEEE, 2023. DOI: 10.23919/SICE59929.2023.10354236.

- M. Danner, B. Hadžić, R. Radloff, et al., "Overcome ethnic discrimination with unbiased machine learning for facial data sets," in Proceedings of the 18th International Joint Conference on Computer Vision, Imaging and Computer Graphics Theory and Applications (VISIGRAPP 2023), Volume 5: VISAPP, Lisbon, Portugal, February 19-21, 2023, P. Radeva, G. M. Farinella, and K. Bouatouch, Eds., SCITEPRESS, 2023, pp. 464–471. DOI: 10.5220/0011624900003417.

- M. Danner, B. Hadžić, T. Weber, X. Zhu, and M. Rätsch, "Towards equitable AI in HR: Designing a fair, reliable, and transparent human resource management application," in Deep Learning Theory and Applications - 4th International Conference (DeLTA 2023), Rome, Italy, July 13-14, 2023, Proceedings, D. Conte, A. L. N. Fred, O. Gusikhin, and C. Sansone, Eds., Communications in Computer and Information Science, vol. 1875, Springer, 2023, pp. 308–325. DOI: 10.1007/978-3-031-39059-3_21.

- M. Danner, P. Huber, M. Awais, M. Rätsch, and J. Kittler, "GAN-powered model & landmark-free reconstruction: A versatile approach for high-quality 3D facial and object recovery from single images," in Deep Learning Theory and Applications - 4th International Conference (DeLTA 2023), Rome, Italy, July 13-14, 2023, Proceedings, D. Conte, A. L. N. Fred, O. Gusikhin, and C. Sansone, Eds., Communications in Computer and Information Science, vol. 1875, Springer, 2023, pp. 403–418. DOI: 10.1007/978-3-031-39059-3_27.

- X. Su, J. Duan, J. Ren, et al., "Personalized clothing recommendation fusing the 4-season color system and users’ biological characteristics," Multimedia Tools and Applications, pp. 1–29, 2023. DOI: 10.1007/s11042-023-16014-4.

- M. Danner, T. Weber, P. Huber, M. Awais, M. Rätsch, and J. Kittler, "Evolutional normal maps: 3D face representations for 2D-3D face recognition, face modelling, and data augmentation," in Proceedings of the 17th International Joint Conference on Computer Vision, Imaging and Computer Graphics Theory and Applications (VISIGRAPP 2022), Volume 5: VISAPP, SCITEPRESS, 2022, pp. 267–274. DOI: 10.5220/0010912000003124.

- T. Weber, M. Danner, B. Zhang, M. Rätsch, and A. Zell, "Semantic risk-aware costmaps for robots in industrial applications using deep learning on abstracted safety classes from synthetic data," in Proceedings of the 17th International Joint Conference on Computer Vision, Imaging and Computer Graphics Theory and Applications (VISIGRAPP 2022), Volume 4: VISAPP, SCITEPRESS, 2022, pp. 984–990. DOI: 10.5220/0010904100003124.

- M. Danner, T. Weber, L. P. Peng, T. Gerlach, X. Su, and M. Rätsch, "Ethically aligned deep learning: Unbiased facial aesthetic prediction," CoRR, vol. abs/2111.05149, 2021. arXiv: 2111.05149.

- M. Danner, P. Huber, M. Awais, Z. Feng, J. Kittler, and M. Rätsch, "Texture-based 3D face recognition using deep neural networks for unconstrained human-machine interaction," in Proceedings of the 15th International Joint Conference on Computer Vision, Imaging and Computer Graphics Theory and Applications (VISIGRAPP 2020), Volume 5: VISAPP, SCITEPRESS, 2020, pp. 420–427. DOI: 10.5220/0008982504200427.

- T. Weber, S. Triputen, M. Danner, et al., "Follow me: Real-time in the wild person tracking application for autonomous robotics," in RoboCup 2017: Robot World Cup XXI, Springer, 2017, pp. 156–167. DOI: 10.1007/978-3-030-00308-1_13.

Courses offered as part of the Bachelor's degree programmes at the Velbert/Heiligenhaus Campus:

- Grundlagen der Informatik

- Grundlagen der Rechnertechnik

- Grundlagen Robotik

- Vertiefung Robotik

Lehrveranstaltungen im Rahmen der Master-Ausbildung am Campus Velbert-Heiligenhaus:

- Robotics

- Wissenschaftliches Schreiben

SpherRobs - Kugelrobote

Das SpheRobs (Spherical Robotics) Projekt erforscht neuartige Ansätze aus der Informatik im Themenfeld verteilte Robotersysteme. Eingesetzt werden vor allem Verfahren aus dem Bereich der künstlichen Intelligenz, Regelungstechnik und Bilddatenverarbeitung. Ziel ist hierbei von der reinen Simulation zu einer Demonstration auf realer Roboterhardware zu gelangen und auch diese auch in der unstrukturierten menschlichen Umgebung umzusetzen. Zu diesem Zweck werden sogenannte Kugelroboter im Roboter- und Rechnertechnik Labor für die Implementierung verwendet. Kugelroboter sind kugelförmige Roboter, die durch die Verschiebung ihres Schwerpunktes in der Lage sind, in eine beliebige Richtung zu rollen.

Videos:

- Box pushing problem solved by spherical robot

- Collaborative box-pushing

- Position control with three spherical robots - Keeping a simple formation

- Control of spherical mobile robots under environmental disturbances

Veröffentlichungen

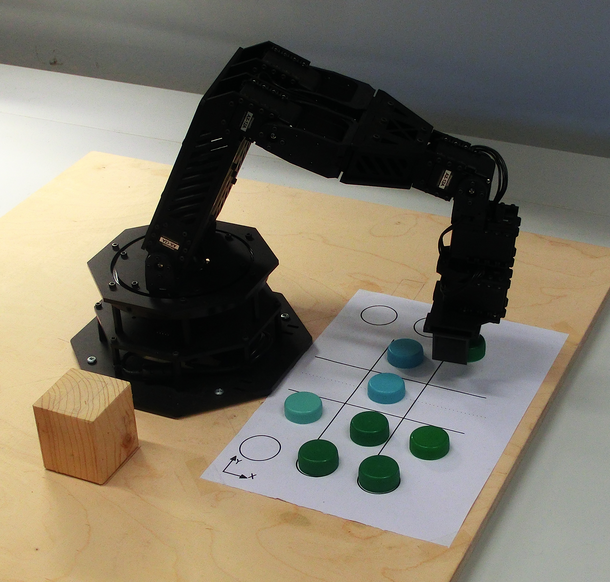

TicTacToe Roboter

Im Rahmen verschiedener Studentenprojekte wurde einem PhantomX Reactor Roboterarm von Trossen Robotics das Spiel Tic Tac Toe beigebracht. Da Tic Tac Toe ein Spiel mit vollständiger Information ist, spielt der Roboter stets ein perfektes Spiel. Der menschliche Gegenspieler kann nie gewinnen, sondern maximal ein Unentschieden erreichen. Videos zur aktuellen Version finden sich hier: https://youtu.be/ciLn0i36-t0

Für die Umsetzung der Software haben die Studenten an folgenden Hauptthemen gearbeitet:

- Kinematik: Modellierung des Roboters mit dem Denavit-Hartenberg Verfahren

- Bilddatenverarbeitung: Erkennung der Spielsituation mit Hile einer Webcam

- Künstliche Intelligenz: Berechnung des nächsten Zuges mit dem MinMax Verfahren

Alle Informationen zu laufenden Veranstaltungen werden auf der Plattform moodle bekanntgegeben.

Head of Workgroup:

Projekt- und Abschlussarbeiten

Wenn Sie Interesse an einer Projekt-, Bachelor- oder Master-Arbeit auf dem Gebiet der technischen Informatik haben, sprechen Sie uns an.

Aktuelle Projektvorschläge:

| Nr. | Themenbereich | Projekttitel | Kurzbeschreibung | Ziel | Tools / Frameworks |

| 1.1 | Navigation | MIRA–ROS 2 Bridge | Entwicklung einer Schnittstelle zwischen der MIRA-API (MetraLabs) und ROS 2. | ROS 2-Kompatibilität für Navigation und Sensordaten. | ROS 2, MIRA SDK, Python/C++ |

| 1.2 | Navigation | Kartenerstellung mit SLAM | Aufbau einer Karte mit RPLIDAR oder Realsense Depth. | Lokalisierung und Mapping in Innenräumen. | ROS 2, slam_toolbox, RViz |

| 1.3 | Navigation | Wegepunkte & Navigationsziele | Verwaltung und Ansteuerung von Positionen („Kitchen“, „Door“ etc.). | Autonome Navigation mit semantischen Wegpunkten. | ROS 2 Navigation2, Behavior Trees |

| 1.4 | Navigation | Dynamische Hindernisvermeidung | Fusion von LIDAR + Kamera zur Personenerkennung und -umfahrung. | Sichere Navigation bei bewegten Hindernissen. | ROS 2, OpenCV, Realsense SDK |

| 2.1 | Perception | Objekterkennung mit KI | Erkennung typischer Haushaltsobjekte (Tasse, Flasche, Buch). | Echtzeit-Objekterkennung mit 3D-Lokalisierung. | YOLOv8, OpenCV, ROS 2, Realsense |

| 2.2 | Perception | Personenerkennung & Tracking | Erkennung und Nachverfolgung von Personen im Raum. | Unterstützung für „Follow-me“-Szenario. | MediaPipe, ROS 2 TF, Realsense |

| 2.3 | Perception | Gestenerkennung & Mensch-Roboter-Interaktion | Steuerung durch Handzeichen (z. B. Stopp, Komm her). | Intuitive Mensch-Roboter-Interaktion. | MediaPipe, OpenPose, Python |

| 2.4 | Perception | Weiterentwicklung Avatar & Mensch-Roboter-Interaktion | Mikrofoneingabe, Spracherkennung, Sprachausgabe, | Avatar mit Sprachinterface für Robotikaufgaben. | Unity3D, Whisper, ChatGPT |

| 2.5 | Perception | Szenenanalyse auf Tischen | Erkennung von Objekten und deren Position auf einer Fläche. | Grundlage für „Clean the table“. | Realsense SDK, Open3D, ROS 2 |

| 3.1 | Manipulation | ROS 2 Integration Neura Lara 3 | Steuerung der LARA 3 über ROS 2 mit MoveIt2. | Basisintegration des Arms in das System. | ROS 2, MoveIt 2, Neura SDK |

| 3.2 | Manipulation | Objekte greifen & ablegen | Automatisiertes Pick-&-Place über Kameraerkennung. | Objektmanipulation in realen Szenen. | MoveIt 2, Realsense, Python |

| 3.3 | Manipulation | Eye-in-Hand-Kalibrierung | Kalibrierung der Kamera auf dem Greiferarm. | Präzise Hand-Auge-Koordination. | OpenCV, ROS 2 TF, MoveIt 2 |

| 3.4 | Manipulation | Objektplatzierung nach Kontext | Ablegen von Objekten an definierten Orten. | Erweiterung der Pick-&-Place-Logik. | MoveIt 2, Behavior Trees |

| 4.1 | HRI | Multimodale Interaktion | Kombination von Sprache, Gesten und visuellen Hinweisen. | Natürliches Zusammenspiel mehrerer Modalitäten. | ROS 2, Python, LLM API |

| 4.2 | HRI | Weiterentwicklung Avatar & Mensch-Roboter-Interaktion | Anzeige von Emotionen (Augen, Gesicht) auf Robot-Display. 3D-Animation | Menschlichere Kommunikation. | Unity3D, |

| 4.3 | HRI | Dialogsystem mit LLM | KI-basierte Sprachinteraktion mit Kontext. | Intelligente, kontextbewusste Kommunikation. | LangChain, ROS 2 Bridge, GPT API |

| 4.4 | HRI | Intent-Erkennung | Klassifikation der Absicht des Nutzers (z. B. „bring object“, „follow me“). | Semantische Interpretation natürlicher Befehle. | NLP, scikit-learn, ROS 2 |

| 5.1 | Hardware | Embedded AI auf Jetson | Einrichtung eines Jetson als ROS 2 Edge Node. | GPU-beschleunigte KI-Inferenz. | JetPack, ROS 2, Docker |

| 5.2 | Hardware | Sensorsynchronisation | Zeitliche Abstimmung von LIDAR, Kamera und Audio. | Präzise Sensordatenfusion. | ROS 2 message_filters, PTP |

| 5.3 | Hardware | Webinterface & Remote Control | Steuerung und Statusanzeige über Browser. | Cloud-/Edge-Anbindung. | ROSBridge, Flask, WebRTC |

| 5.4 | Hardware | Energie- und Sicherheitsmanagement | Integration von Batterie- und Not-Aus-Monitoring in ROS. | Betriebssicherheit & Diagnose. | ROS Diagnostics, Python |

| 6.1 | Systemintegration | „Bring me the cup“ | Roboter findet, greift und bringt ein Objekt. | Kombination: Navigation + Perception + Manipulation + HRI. | alle Module |

| 6.2 | Systemintegration | „Follow me“ | Roboter folgt einer Person durch die Umgebung. | Kombination: Tracking + Navigation + HRI. | ROS 2, MediaPipe, Nav2 |

| 6.3 | Systemintegration | „Clean the table“ | Roboter erkennt und räumt Objekte ab. | Kombination: Objekterkennung + Manipulation + Planung. | YOLO, MoveIt 2 |

| 6.4 | Systemintegration | „Ask and Deliver“ | Sprachbefehl → Objekt holen → Übergabe an Nutzer. | Komplettsystem mit natürlicher Interaktion. | ROS 2, LLM, Navigation2 |